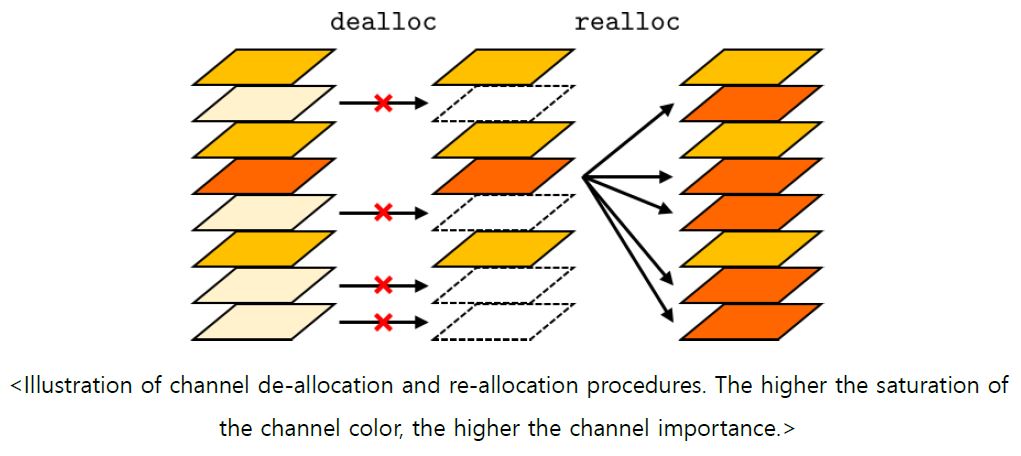

Title: Training CNNs with Selective Allocation of Channels

Authors: Jongheon Jeong and Jinwoo Shin

Recent progress in deep convolutional neural networks (CNNs) have enabled a simple paradigm of architecture design: larger models typically achieve better accuracy. Due to this, in modern CNN architectures, it becomes more important to design models that generalize well under certain resource constraints, e.g. the number of parameters. In this paper, we propose a simple way to improve the capacity of any CNN model having large-scale features, without adding more parameters. In particular, we modify a standard convolutional layer to have a new functionality of channel-selectivity, so that the layer is trained to select important channels to re-distribute their parameters. Our experimental results under various CNN architectures and datasets demonstrate that the proposed new convolutional layer allows new optima that generalize better via efficient resource utilization, compared to the baseline.

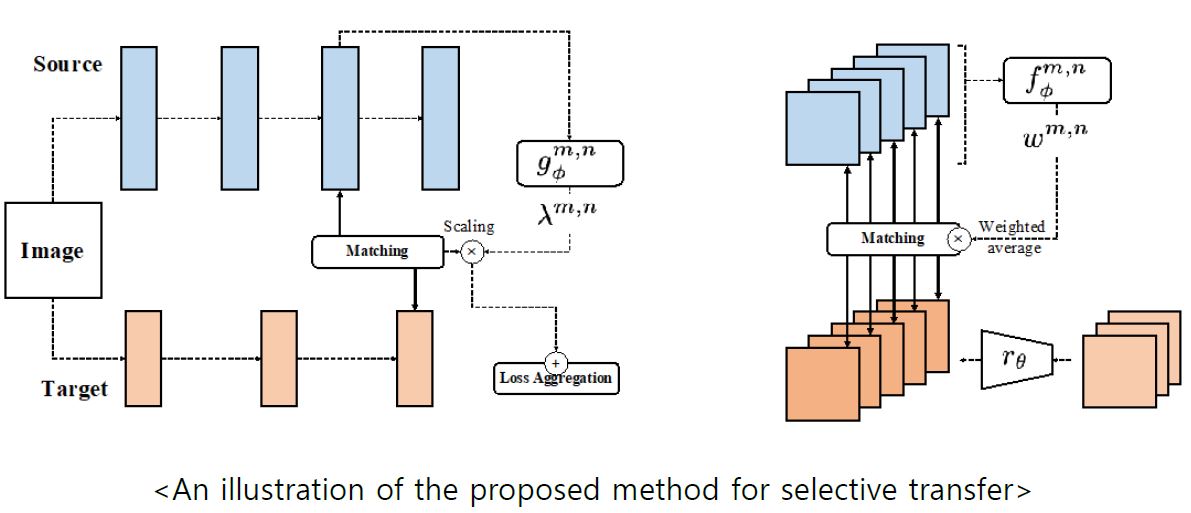

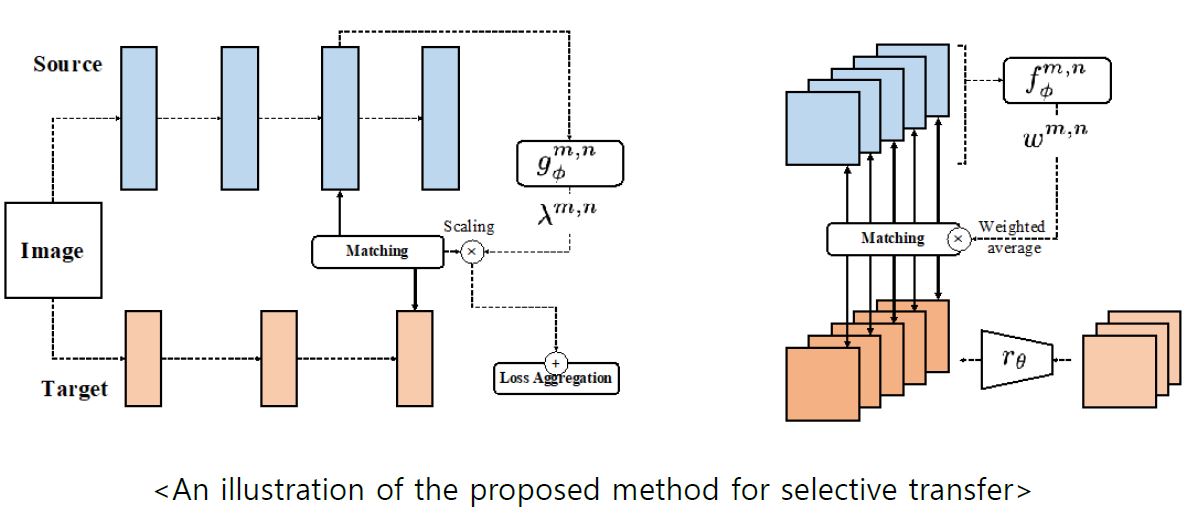

Title: Learning What and Where to Transfer

Authors: Yunhun Jang, Hankook Lee, Sung Ju Hwang, Jinwoo Shin

As the application of deep learning has expanded to real-world problems with insufficient volume of training data, transfer learning recently has gained much attention as means of improving the performance in such small-data regime. However, when existing methods are applied between heterogeneous architectures and tasks, it becomes more important to manage their detailed configurations and often requires exhaustive tuning on them for the desired performance. To address the issue, we propose a novel transfer learning approach based on meta-learning that can automatically learn what knowledge to transfer from the source network to where in the target network. Given source and target networks, we propose an efficient training scheme to learn meta-networks that decide (a) which pairs of layers between the source and target networks should be matched for knowledge transfer and (b) which features and how much knowledge from each feature should be transferred. We validate our meta-transfer approach against recent transfer learning methods on various datasets and network architectures, on which our automated scheme significantly outperforms the prior baselines that find “what and where to transfer” in a hand-crafted manner.

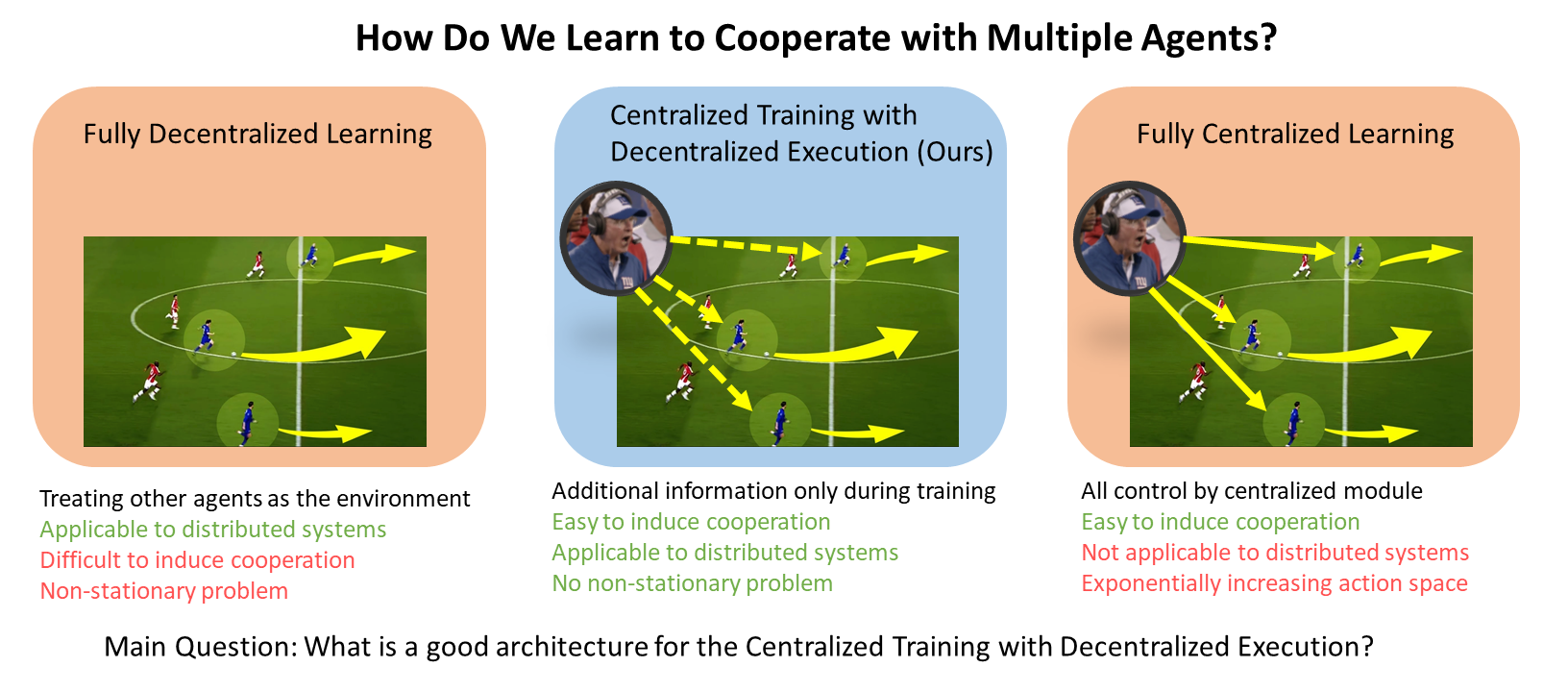

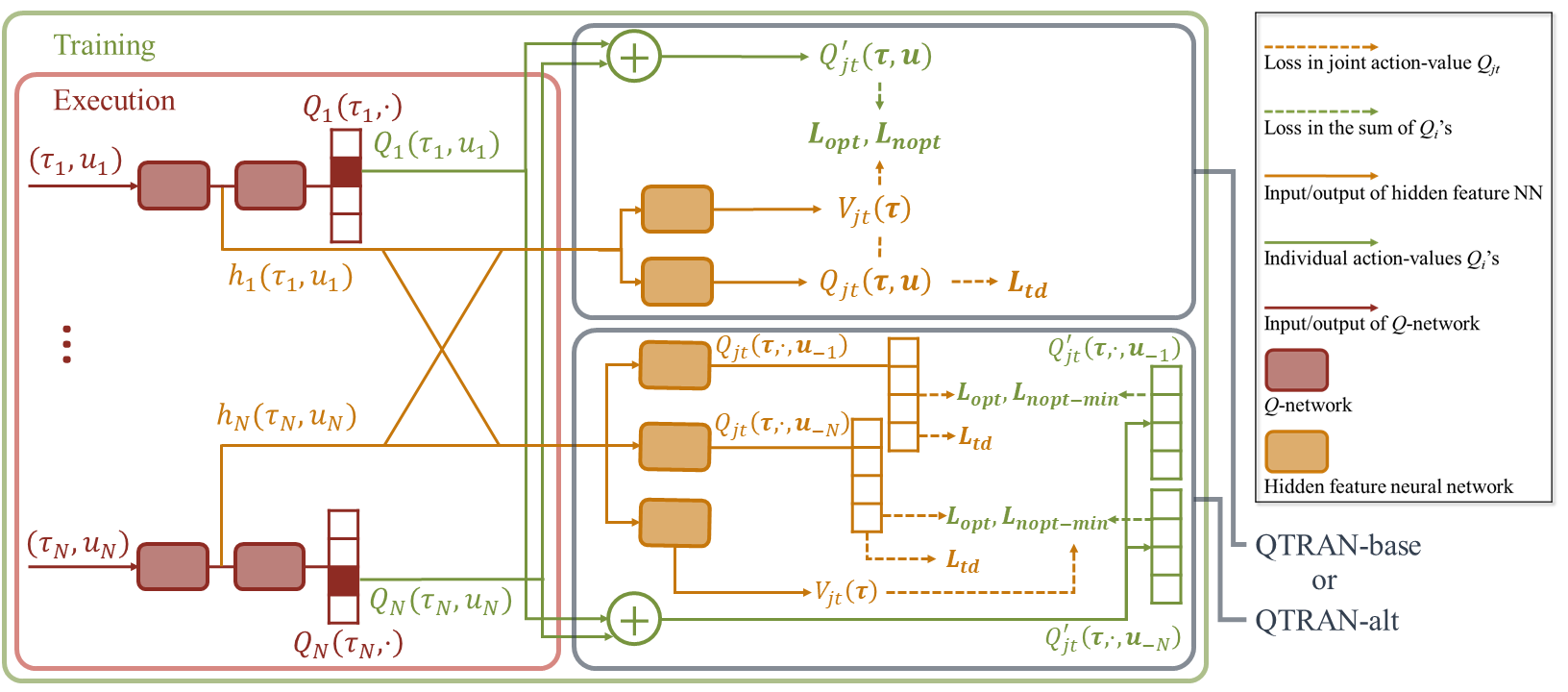

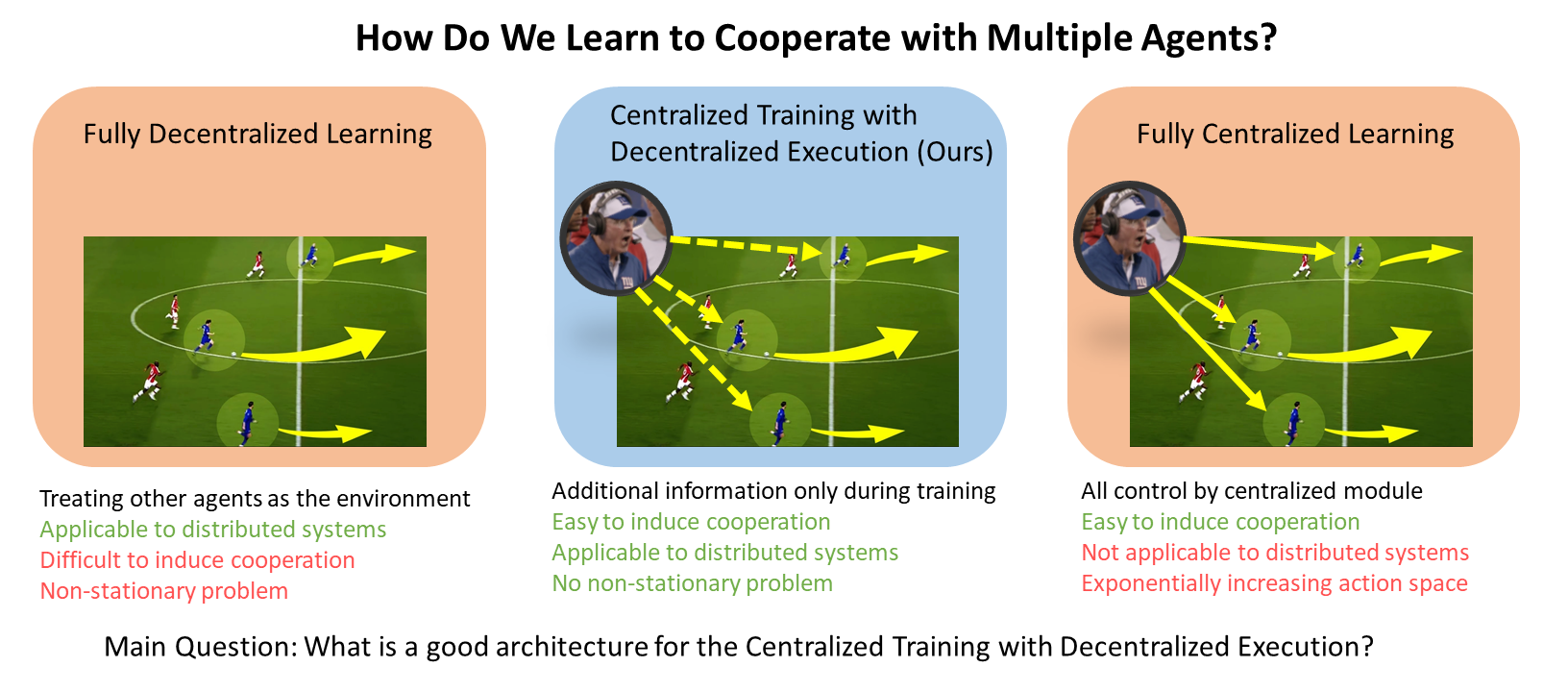

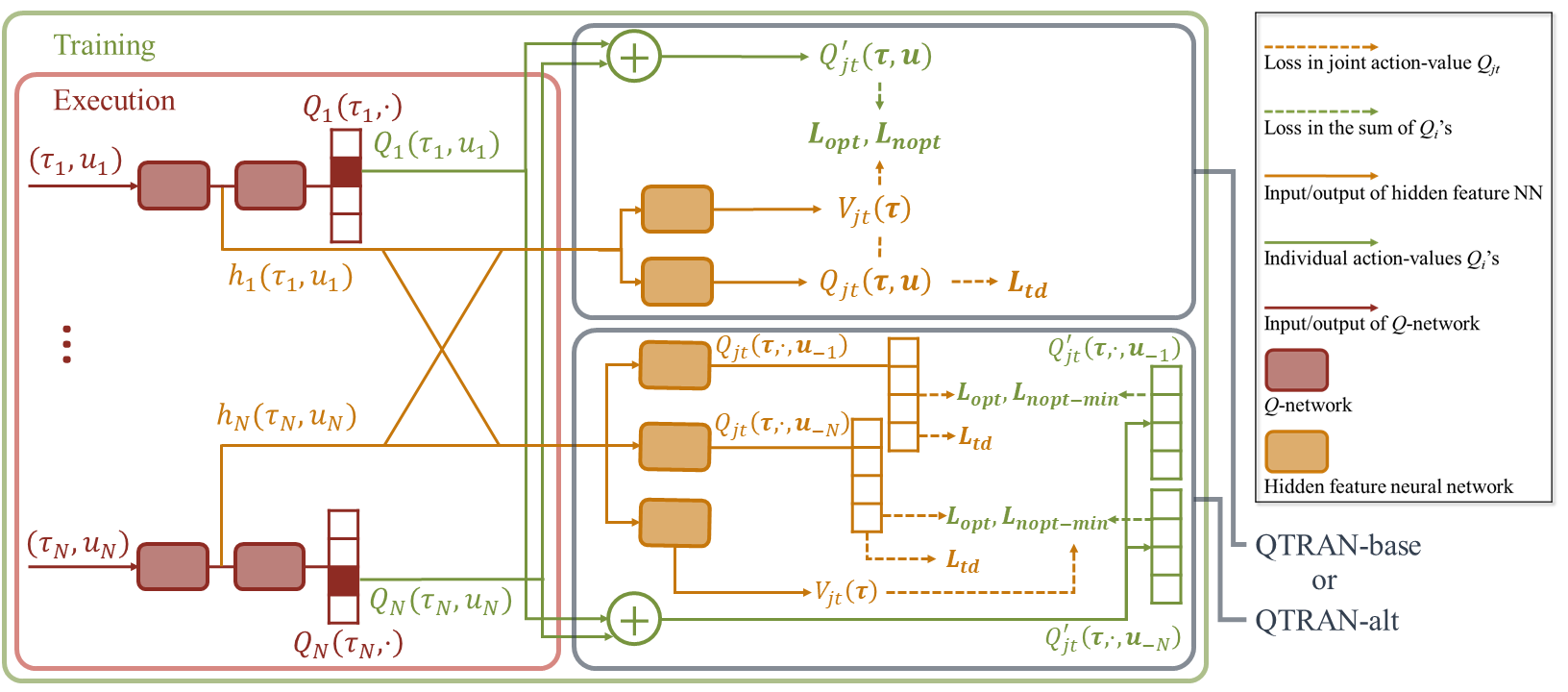

Title: QTRAN: Learning to Factorize with Transformation for Cooperative Multi-Agent Reinforcement Learning

Authors: Kyunghwan Son, Daewoo Kim, Wan Ju Kang, David Earl Hostallero, Yung Yi

We explore value-based solutions for multi-agent reinforcement learning (MARL) tasks in the centralized training with decentralized execution (CTDE) regime popularized recently. However, VDN and QMIX are representative examples that use the idea of factorization of the joint action-value function into individual ones for decentralized execution. VDN and QMIX address only a fraction of factorizable MARL tasks due to their structural constraint in factorization such as additivity and monotonicity. In this paper, we propose a new factorization method for MARL, QTRAN, which is free from such structural constraints and takes on a new approach to transforming the original joint action-value function into an easily factorizable one, with the same optimal actions. QTRAN guarantees more general factorization than VDN or QMIX, thus covering a much wider class of MARL tasks than does previous methods. Our experiments for the tasks of multi-domain Gaussian-squeeze and modified predator-prey demonstrate QTRAN’s superior performance with especially larger margins in games whose payoffs penalize non-cooperative behavior more aggressively.

인터넷을 통하여 동영상을 시청할 때, 네트워크의 접속 상태에 따라 동영상의 화질이 낮아지는 경우가 있습니다. 이런 현상은 시시각각 변하는 인터넷 대역폭에 맞춰 스트리밍 중인 비디오 화질을 실시간으로 조절하는 적응형 스트리밍 방식을 이용하기 때문에 발생하게 됩니다. 이런 문제를 해결하기 위해 최근 우리 학부 신진우 ∙ 한동수 교수 공동 연구팀이 ‘적응형 스트리밍’과 딥러닝 기반 ‘초해상화’ 기술을 접목하여 네트워크 상태와 상관없이 동영상의 화질을 개선할 수 있는 기술을 개발하였습니다.

연구팀은 저화질의 영상을 고화질로 변경하기 위해 딥러닝 기술의 일종인 CNN(Convolution Neural Network)을 이용하여 저화질과 고화질을 반복적으로 학습시키고, 이것을 바탕으로 디스플레이에서 수평과 수직 비율을 정교하게 확장하는 방법인 ‘초해상화’ 기술을 이용하였습니다. 특히 동영상을 스트리밍 할 때 초해상화를 구현하는 CNN이 함께 다운로드 되어, 네트워크의 상태에 관계 없이 실시간으로 화질을 개선하는 방법을 제시하였습니다. CNN 파일의 경우, 크기가 최대 2MB로 동영상의 크기보다 훨씬 작아 동영상과 함께 다운받아도 무리가 없도록 하였습니다. 또한 CNN 파일을 여러 조각으로 나눠 내려받는 방식으로 설계하였기 때문에 일부만 내려받아도 조금 떨어지는 성능의 초해상화 기술을 동영상에 적용하도록 하였습니다.

연구팀은 이 시스템으로 최대 26.9% 적은 인터넷 대역폭으로도 최신 적응형 스티리밍과 같은 체감 품질을 제공할 수 있음을 보였고, 같은 인터넷 대역폭 환경이라면 40% 높은 체감 품질을 제공할 수 있다고 설명했습니다. 한동수 교수는 “이 기술은 현재 유튜브, 넷플릭스 등 스트리밍 업체에서 쓰는 비디오 전송 시스템에 적용한 것으로 실용성에 큰 의의가 있다.”며 “지금은 데스크톱에서만 구현했지만, 향후 모바일 기기에서도 작동할 수 있도록 발전시켜나갈 것”이라고 말했습니다.

<기사 Link>

IT조선

http://it.chosun.com/m/svc/article.html?contid=2018103002324&Dep0=m.search.naver.com&utm_source=m.search.naver.com&utm_medium=unknown&utm_campaign=itchosun

중앙일보

https://m.news.naver.com/read.nhn?mode=LSD&mid=sec&sid1=101&oid=025&aid=0002860051

우리 학부 황의종 교수가 ‘모두를 위한 AI’라는 주제 하에 AI 혁신에 대한 지식과 도전 과제에 대한 생각을 공유하는 ‘AI with Google 2018’ 컨퍼런스에서 산업계 전문가들과 발표 및 패널 토의를 가져 국내 언론에 보도되었습니다.

이 날 행사에는 Google AI 총괄 Jeff Dean 박사가 키노트 강연을 진행하였고 학계에서는 황의종 교수가 유일하게 참여해 ‘KAIST에서의 AI 연구 및 인재 양성’을 주제로 발표를 하였으며 이어진 패널 토의에서는 AI 혁신에 대한 지식과 앞으로의 도전 과제를 공유하였습니다.

황 교수는 Google 연구소에서 5년간 연구원으로 근무하였고 TensorFlow Extended 머신러닝 플랫폼의 데이터 인프라를 공동개발하면서 ACM SIGKDD 논문, ACM SIGMOD tutorial 등의 연구실적이 있습니다.

<대표 기사>

http://www.bloter.net/archives/313731

false

Prof. Jin-woo Shin, Prof. Dongsu Han’s group’s Quang Nguyen Ngoc, Jee-hoon Tak, Byuck-chan Lee participated in the modeling technology of used cars using deep learning technique developed by KB Capital and reported to domestic media including Money Today.

This system utilizes deep running to derive used car quotes. Using the developed deep-learning model, AI learns about hundreds of thousands of vehicles, and rates an accurate used car in consideration of about 50 factors that influence the price of the vehicle (sales time, mileage, fuel economy, vehicle type, etc.). Accurate quotes are derived through processes that reflect what is often considered a careful consideration in the used car market, such as time of sale, mileage, fuel economy, and type of vehicle. KB Capital will be able to provide the accurate used car quotes to customers through KB Chachacha site in real time by using the developed deep running model on the deep running server using the latest GPU and estimating residual value that reflects the vehicle specific price.

This research is an accomplishment of KB-KAIST financial AI research center (center director: professor Dae-sik Kim) project to upgrade used car market data provided to KB Chachacha used cars site. The used car model based on AI model developed by KAIST will be provided through the KB Chachacha Site.

<Link>

이융 교수, 박경수 교수, 한동수 교수가 ‘AI융합기술 기반 드론’ 개발과 관련하여 전자신문에 보도되었습니다.

이융·박경수·한동수 전기 및 전자공학부 교수팀은 지능형 AI 드론이 다른 드론, 외부 환경과 소통해 효율적으로 임무를 수행할 수 있도록 하는 통합 플랫폼 기술을 개발하고 있다고 소개되었습니다.

기사1 Link: http://www.etnews.com/20170602000167 “[KAIST AI를 선도한다]KAIST, ‘똑똑한 드론’ 플랫폼 개발… 숲 속 길 찾는 연구도”

기사2 Link: http://www.etnews.com/20170602000165 “[KAIST AI를 선도한다] ‘드론 기술 발전 위해서는…’ 눈에 보이지 않는 요소 기술 집중해야”

김용대 교수, 신승원 교수가 AI를 이용한 정보보안 관련 연구로 전자신문에 보도되었습니다.

김용대 교수 연구실은 센서, 정보통신 센서의 정보보안 허점을 공격하는 방법과 AI 기반 기술 보안을 철저히 하는 연구로 소개되었습니다.

신승원 교수 연구실은 ‘다크웹’에서 각종 범죄와 테러 정보를 탐지하고, 정보 게시자 신원까지 분석하는 기술 개발로 소개되었습니다.

기사 Link: http://www.etnews.com/20170507000055 [KAIST, AI를 선도한다] [KAIST AI를 선도한다]<4>AI 이용한 정보보안