전기및전자공학부 노용만 교수 연구팀, GPT-4V 뛰어넘는 멀티모달 대형언어모델 개발

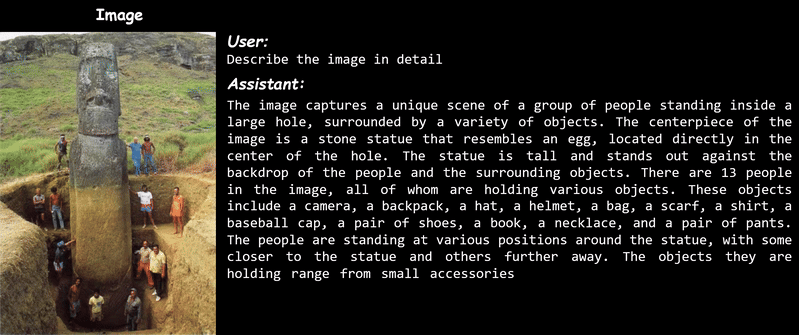

<(좌측부터) 노용만 교수, 이병관 박사과정, 박범찬 석박통합과정, 김채원 박사과정 사진>

전기및전자공학부 노용만 교수 연구팀이 오픈AI(OpenAI)의 GPT-4V와 구글의 제미나이-프로(Gemini-Pro)와 같은 비공개형 상업 모델인 초대형 언어모델의 시각 성능을 뛰어넘는 공개형 멀티모달 대형 언어모델을 개발해 출시했다고 20일 밝혔다. 멀티모달 대형 언어모델이란 텍스트뿐만 아니라 이미지 데이터 유형까지 처리할 수 있는 초대형 언어모델을 말한다.

최근 대형언어모델(LLM)의 발전과 시각적 지시 조정(Visual Instruction Tuning)의 등장으로 멀티모달 대형언어모델이 큰 주목을 받고 있다.

그러나, 해외 대형 기업의 풍부한 컴퓨팅 자원의 지원으로부터 인간의 뇌에 있는 신경망의 개수와 유사한 수준의 파라미터를 가진 초대형모델들이 만들어지고 있고, 개발된 모델들이 비공개로 개발되다 보니 학계 수준에서 개발된 대형언어모델과 비교했을 때, 성능 및 기술 격차가 나날이 커지고 있다.

다시 말해, 현재까지 개발된 공개형 대형언어모델들은 현재까지 비공개형 대형언어모델인 GPT-4V와 제미나이-프로(Gemini-Pro)와 유사한 성능을 내지 못할 뿐 아니라 여전히 현저한 성능 차이를 보이고 있었다.

멀티모달 대형언어모델의 성능을 올리기 위해 기존의 공개형 대형언어모델들은 모델의 크기를 키워 학습할 수 있는 역량을 키우거나 다양한 시각 언어 태스크(Vision Language Task)를 다루는 시각적 지시 조정 데이터셋(Visual Instruction Tuning Dataset)을 더욱 고품질로 만들어 확장하는 방식을 사용했다.

하지만 이런 방식은 아주 큰 연산 자원을 요구하거나 노동집약적인 단점이 있어, 멀티모달 대형언어모델의 성능을 높이기 위한 새로운 효율적인 방법의 필요성이 대두되고 있다.

KAIST 전기및전자공학부 노용만 교수 연구팀은 단순히 모델의 크기를 키우거나 고품질의 시각적 지시 조정 데이터셋을 만들지 않고 멀티모달 대형언어모델의 시각 성능을 획기적으로 높인 기술 2개를 연속적으로 개발했다고 밝혔다.

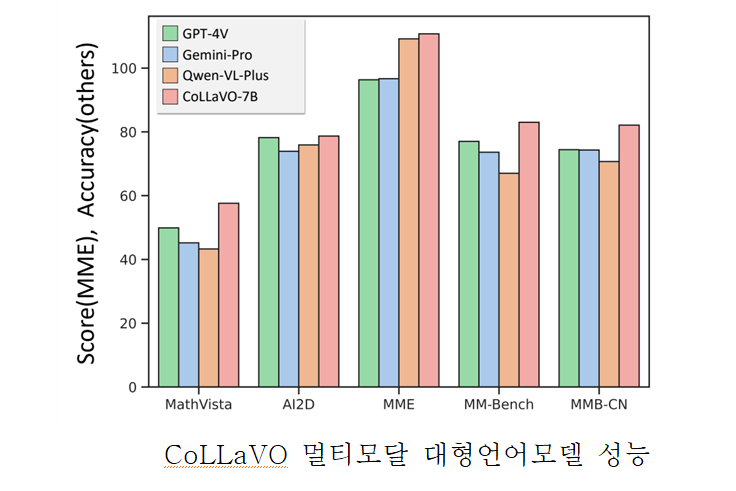

연구팀이 개발한 첫번째 기술인 ‘콜라보(CoLLaVO)’는 현존하는 공개형 멀티모달 대형언어모델이 비공개형 모델의 성능에 비해 현저하게 낮은 이유를 일차적으로 물체 수준에 대한 이미지 이해 능력이 현저하게 떨어진다는 것을 먼저 검증해 보였다.

그리고, 모델의 물체 수준 이미지 이해 능력이 시각-언어 태스크 처리 능력에 대한 결정적인 성능과 유의미한 상관관계가 있다는 것을 밝혔다.

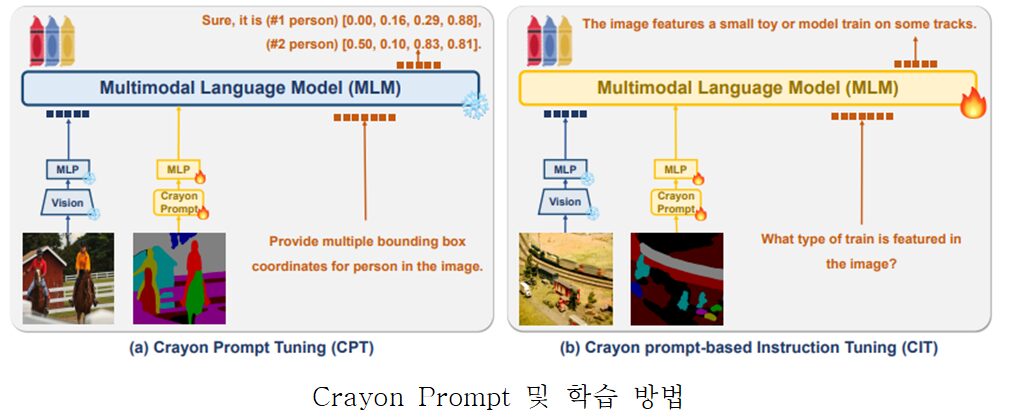

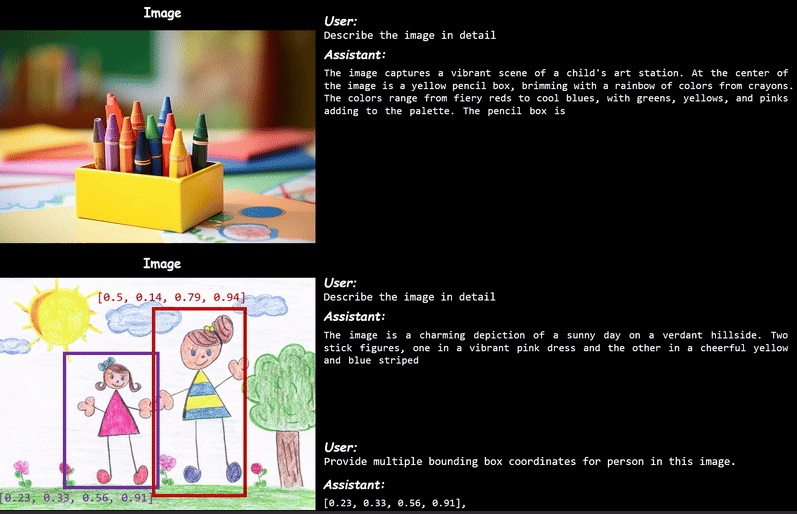

연구팀은 해당 능력을 효율적으로 증가시켜 시각-언어 태스크에 대한 성능을 향상 하기 위해 ‘크레용 프롬프트(Crayon Prompt)’라는 시각적 프롬프트를 새롭게 제안했는데, 이는 컴퓨터 비전 모델 중 하나인 전체적 분할(panoptic segmentation) 모델을 활용해 이미지 내의 정보를 배경과 물체 단위로 분할하고 각 배경 및 물체에 대한 정보를 멀티모달 대형언어모델에 입력으로 직접 넣어주는 새로운 방법을 뜻한다.

추가로, 연구팀은 시각적 지시 조정 단계에서 크레용 프롬프트로 학습한 정보를 잃어버리지 않기 위해 ‘듀얼 큐로라(Dual QLoRA)’라는 학습 전략을 사용해 물체 수준 이미지 이해 능력과 시각-언어 태스크 처리 능력을 서로 다른 파라미터로 학습해 서로 간의 정보를 잃지 않게 만드는 획기적인 학습 전략을 제안했다. 이를 통해, 콜라보(CoLLaVO) 멀티모달 대형언어모델은 이미지 내에서 배경 및 물체를 구분하는 능력이 뛰어나 일차원적인 시각 구분 능력이 크게 향상됐다고 밝혔다.

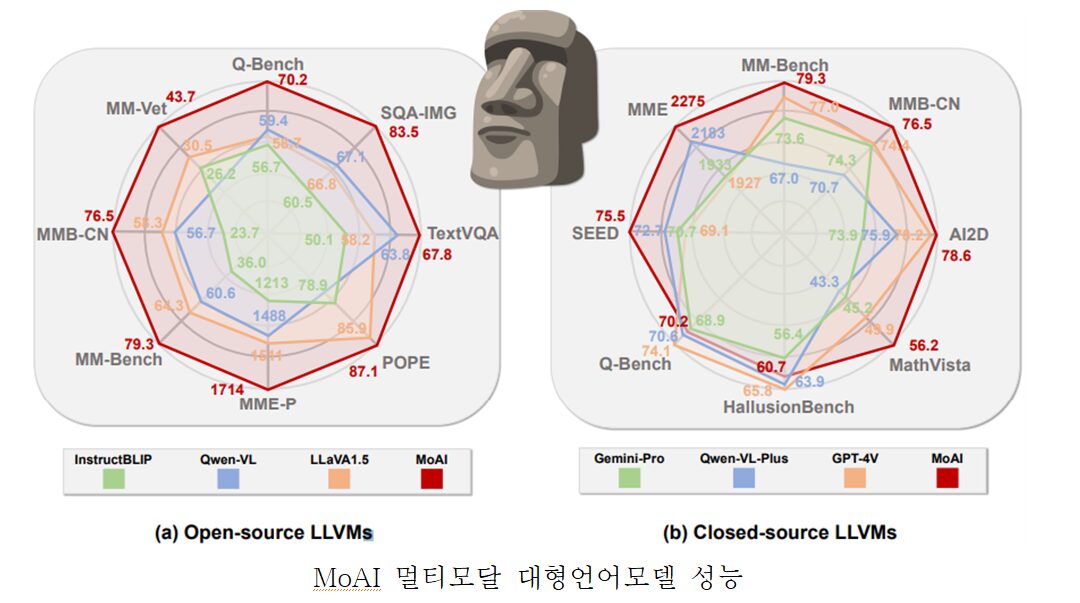

노용만 교수 연구팀은 곧이어 두 번째 대형언어모델 ‘모아이(MoAI)’를 개발 및 공개했는데, 이는 인간이 사물을 판단할 때 물체의 존재, 상태, 물체 간의 상호작용, 배경에 대한 이해, 텍스트에 대한 이해 등으로부터 상황을 판단하는 인지과학적인 요소에 영감을 받아서 만들어졌다고 밝혔다.

이는 기존 멀티모달 대형언어모델이 텍스트에 의미적으로 정렬된 시각 인코더(vision encoder)만을 사용하기 때문에, 이미지 픽셀 수준에서의 상세하고 종합적인 실세계 장면 이해가 부족하다는 점을 지적하며, 이런 인지과학적인 요소를 멀티모달 대형언어모델에 부여하기 위해서 전체적 분할(Panoptic Segmentation), 검출할 수 있는 물체에 한계가 없는 물체 검출기(Open-World Object Detection), 상황 그래프 생성(Scene Graph Generation), 그리고 글자 인식(Optical Character Recognition), 이렇게 4가지의 컴퓨터 비전 모델을 종합적으로 사용한다.

이런 4가지 컴퓨터 비전 모델들의 결과를 받으면 모두 인간이 이해할 수 있는 언어로 변환한 뒤에 멀티모달 대형언어모델에 입력으로 직접 사용했다.

이러한 간단하고 효율적인 방식인 콜라보(CoLLaVO)의 크레용 프롬프트(Crayon Prompt), 듀얼큐로라(DualQLoRA)와 모아이(MoAI)의 다양한 컴퓨터 비전모델의 집합체를 이용해 비공개형 상업 모델인 오픈AI의 GPT-4V와 구글의 제미나이-프로(Gemini-Pro)를 뛰어넘는 성능을 검증했다고 연구팀은 밝혔다.

2가지 연속적인 멀티모달 대형언어모델인 콜라보(CoLLaVO)와 모아이(MoAI)는 KAIST 전기및전자공학부 이병관 박사과정이 제1 저자로 참여하고 박범찬 석박사통합과정, 김채원 박사과정이 공동 저자로 참여했다.

연구팀이 개발한 콜라보(CoLLaVO) 공개형 대형언어모델은 자연어 처리(NLP) 분야 최고의 국제 학회인 ‘Findings of the Association for Computational Linguistics(ACL Findings) 2024’에 5월 16일 자로 학회에 승인받았고, 모아이(MoAI)는 컴퓨터 비전 최고의 국제 학회인 ‘European Conference on Computer Vision(ECCV) 2024’학회 승인 결과를 기다리고 있다고 밝혔다.

[1] CoLLaVO 데모 GIF 영상 https://github.com/ByungKwanLee/CoLLaVO

< MoAI 데모 GIF 영상 >