‘음향 분리 및 분류 기술’은 드론, 공장 배관, 국경 감시 시스템 등에서 이상 음향을 조기에 탐지하거나, AR/VR 콘텐츠 제작 시 공간 음향(Spatial Audio)을 음원별로 분리해 편집할 수 있도록 하는 차세대 인공지능(AI) 핵심 기술이다.

우리 학부 최정우 교수 연구팀이 세계 최고 권위의 음향 탐지 및 분석 대회인 ‘IEEE DCASE 챌린지 2025’에서 ‘공간 의미 기반 음향 장면 분할(Spatial Semantic Segmentation of Sound Scenes)’ 분야에서 우승을 차지했다.

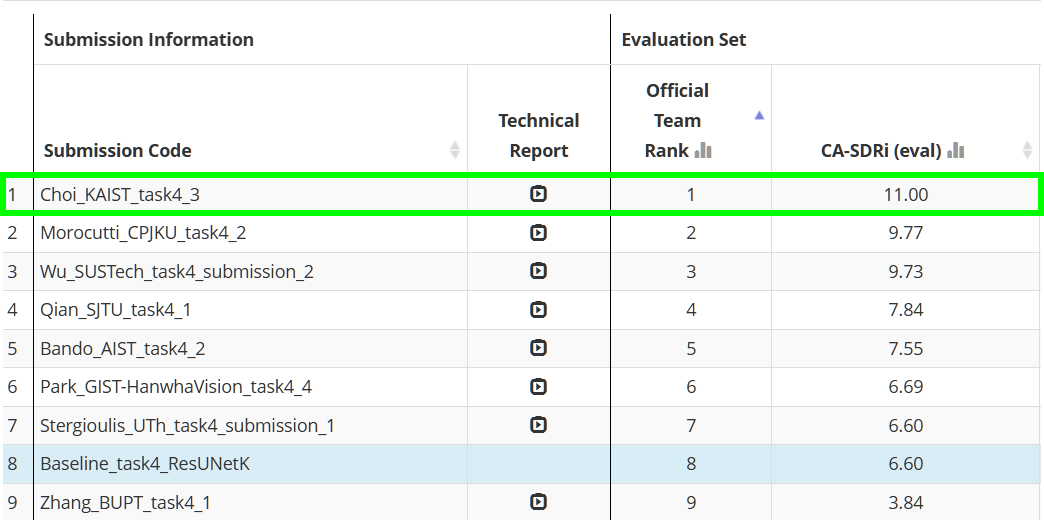

이번 대회에서 연구팀은 전 세계 86개 참가팀과 총 6개 분야에서 경쟁 끝에 최초 참가임에도 세계 1위 성과를 거두었다. 최정우 교수 연구팀은 이동헌 박사, 권영후 석박통합과정생, 김도환 석사과정생으로 구성되었다.

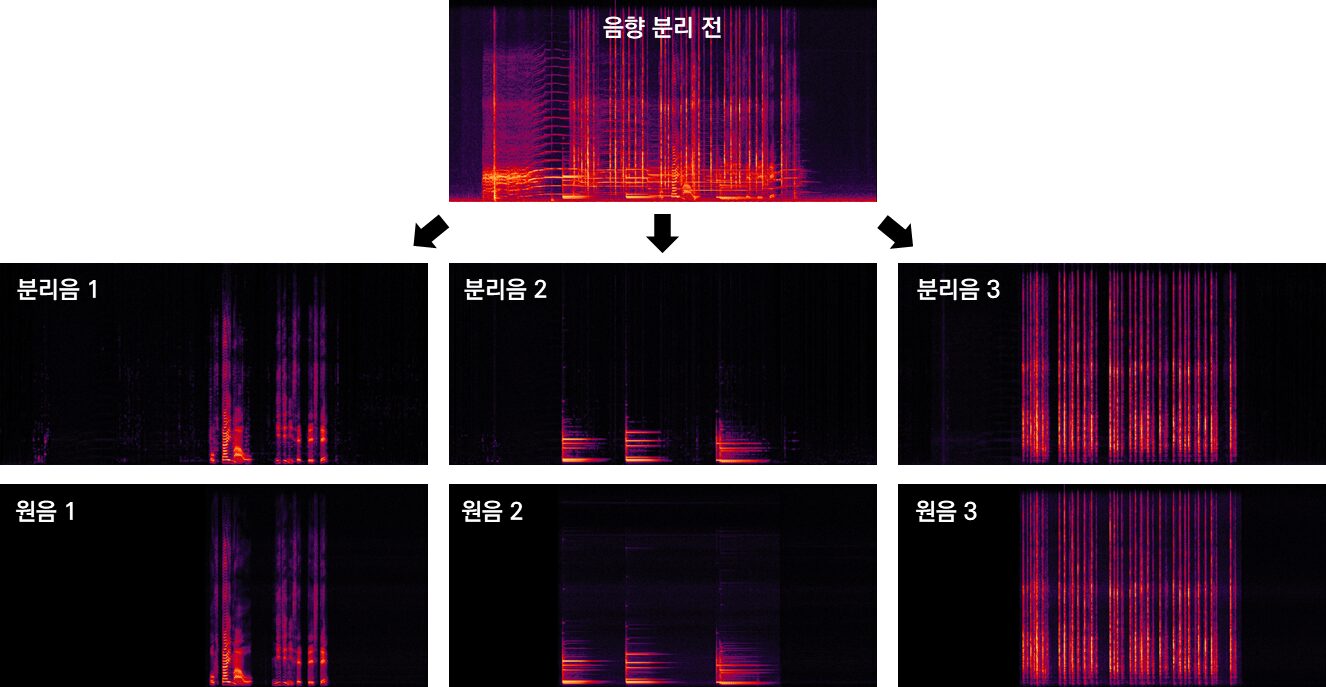

연구팀이 참가한 ‘공간 의미 기반 음향 장면 분할’의 ‘태스크(Task) 4’ 분야는 여러 음원이 혼합된 다채널 신호의 공간 정보를 분석해 개별 소리를 분리하고 18종으로의 분류를 수행해야 하는 기술 난이도가 매우 높은 분야이다. 연구팀은 오는 10월, 바르셀로나에서 열리는 DCASE 워크숍에서 기술을 발표할 예정이다.

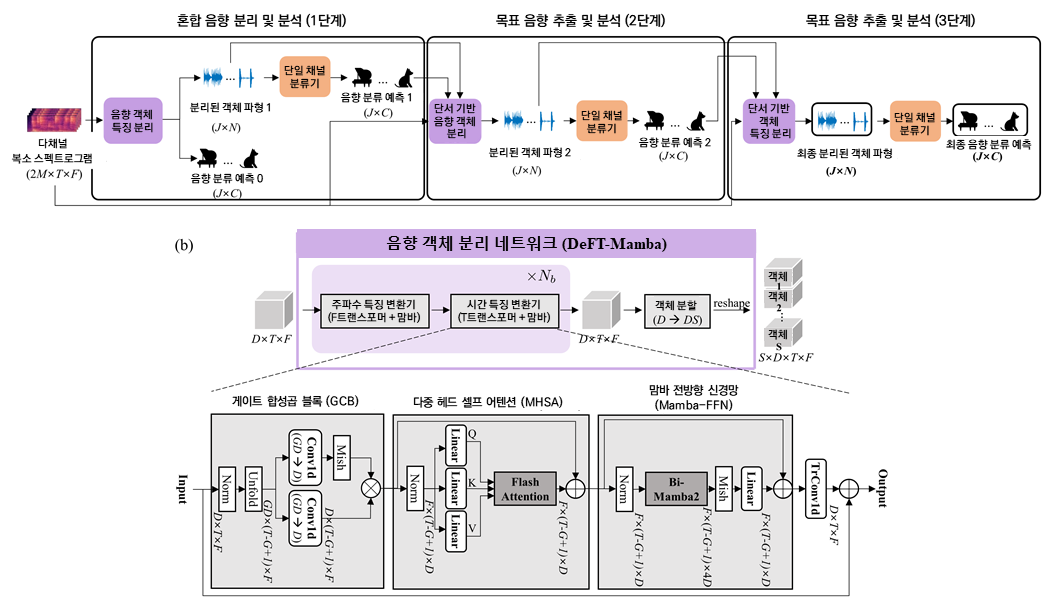

연구팀의 이동헌 박사는 올해 초 트랜스포머(Transformer)와 맘바(Mamba) 아키텍처를 결합한 세계 최고 성능의 음원 분리 인공지능을 개발했으며, 챌린지 기간 동안 권영후 연구원을 중심으로 1차로 분리된 음원의 파형과 종류를 단서로 해 다시 음원 분리와 분류를 수행하는 ‘단계적 추론 방식’의 AI 모델을 완성했다.

이는 사람이 복잡한 소리를 들을 때 소리의 종류나 리듬, 방향 등 특정 단서에 기반해 개별 소리를 분리해 듣는 방식을 AI가 모방한 모델이다.

이를 통해, 순위를 결정하는 척도인 AI가 소리를 얼마나 잘 분리하고 분류했는지 평가하는 ‘음원의 신호대 왜곡비 향상도(CA-SDRi)*’에서 참가팀 중 유일하게 두 자릿수 대의 성능(11 dB)을 보여, 기술적인 우수성을 입증하였다. *음원의 신호대 왜곡비 향상도(CA-SDRi): 기존의 오디오와 비교해 얼마나 더 선명하게(덜 왜곡되게) 원하는 소리를 분리했는지를 dB(데시벨) 단위로 측정하고 숫자가 클수록 더 정확하고 깔끔하게 소리를 분리했다는 뜻임

최정우 교수는 “연구팀은 최근 3년간 세계 최고의 음향 분리 AI 모델을 선보여 왔으며, 그 결과를 공식적으로 인정받는 계기가 되어 기쁘다”면서 “난이도가 대폭 향상되고, 타 학회 일정과 기말고사로 불과 몇 주간만 개발이 가능했음에도 집중력 있는 연구를 통해 1위를 차지한 연구팀 개개인이 자랑스럽다”고 소감을 밝혔다.

‘IEEE DCASE 챌린지 2025’는 온라인으로 진행됐으며, 4월 1일부터 시작해 6월 15일 인공지능 모델 투고를 마감했고 지난 6월 30일 결과가 발표됐다. 각종 음향 관련 탐지 및 분류 기술을 평가하는 IEEE 신호처리학회(Signal Processing Society) 산하 국제대회인 본 챌린지는 2013년 개최된 이래 음향 분야 인공지능 모델의 세계적인 경연의 장으로 자리매김해 왔다.

한편, 해당 연구는 교육과학기술부의 재원으로 한국연구재단 중견연구자지원사업, STEAM 연구사업 지원 및 방위사업청 및 국방과학연구소 재원으로 미래국방연구센터 지원을 받아 수행됐다.