최근 개발된 로봇들은 계란을 섬세하게 집는 수준에 이르렀는데, 이같은 결과는 손 끝에 집적된 압력 센서가 촉각 정보를 제공했기 때문이다. 그러나, 이러한 세계 최고 수준의 로봇들조차도 물 속, 굽힘, 전자기 간섭과 같은 복잡한 외부 간섭 요소들이 존재하는 환경에서 압력을 정확히 감지하는 것은 아직 어렵다. KAIST 연구진이 물기가 묻은 스마트폰 화면과 같은 환경에서도 외부 간섭 없이 안정적으로 작동하며, 인간의 촉각 수준에 근접한 압력 센서를 개발하는 데 성공했다.

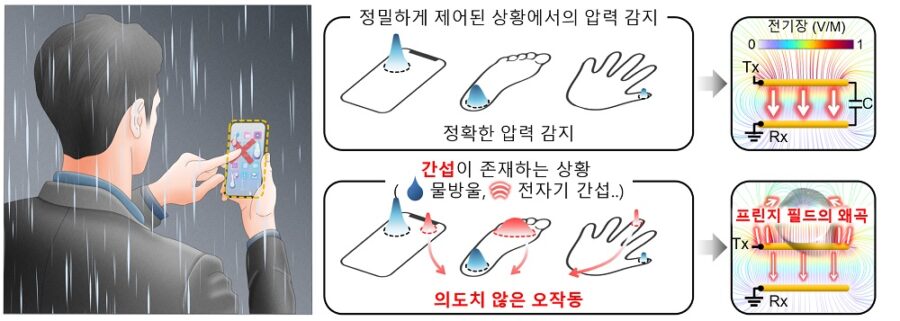

우리 학부 윤준보 교수 연구팀이 비가 오거나 샤워 후 스마트폰 화면에 물이 묻으면, 터치가 엉뚱하게 인식되는 ‘고스트 터치’와 같은 외부 간섭의 영향을 받지 않으면서도 높은 해상도로 압력을 감지할 수 있는 압력 센서를 개발했다.

흔히 터치 시스템으로 사용되고 있는 정전용량 방식 압력 센서는 구조가 간단하고 내구성이 뛰어나 스마트폰, 웨어러블 기기, 로봇 등의 휴먼-머신 인터페이스(Human-Machine Interface) 기술에 널리 활용되고 있다. 그러나 물방울이나 전자기 간섭, 굴곡으로 인한 굽힘 등 외부 간섭 요소에 의해 오작동이 발생하는 치명적인 문제가 있었다.

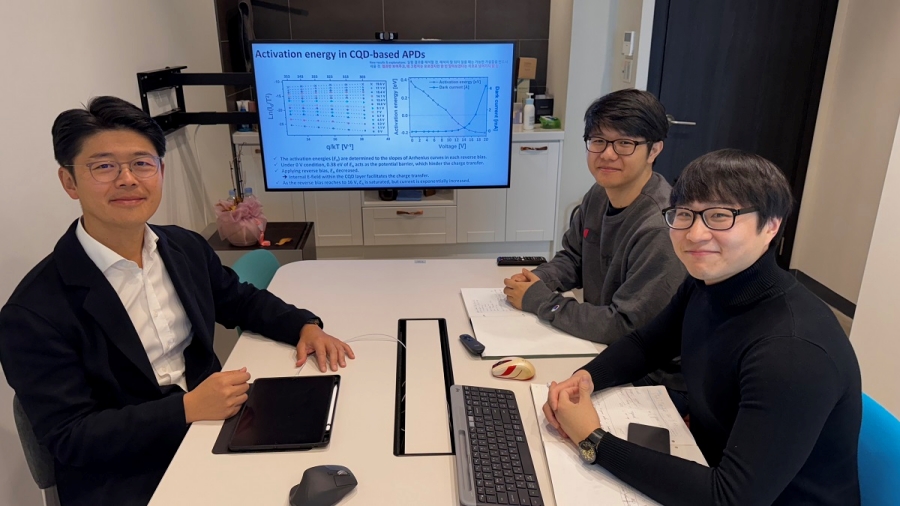

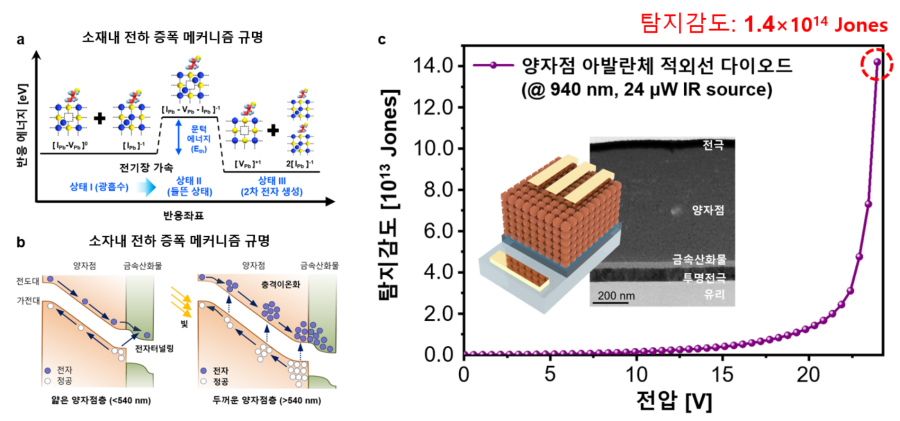

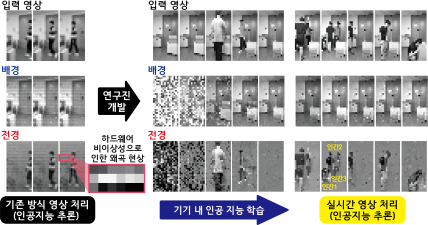

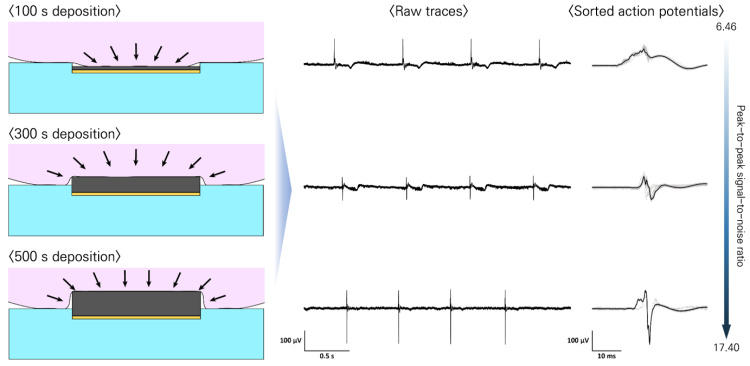

연구팀은 이와 같은 문제를 해결하기 위해 우선 정전용량 방식 압력 센서에서 발생하는 간섭의 원인을 정확히 파악하고자 했다. 그 결과, 센서 가장자리에서 발생하는 ‘프린지 필드(Fringe Field)’가 외부 간섭에 극도로 취약한 것을 확인했다.

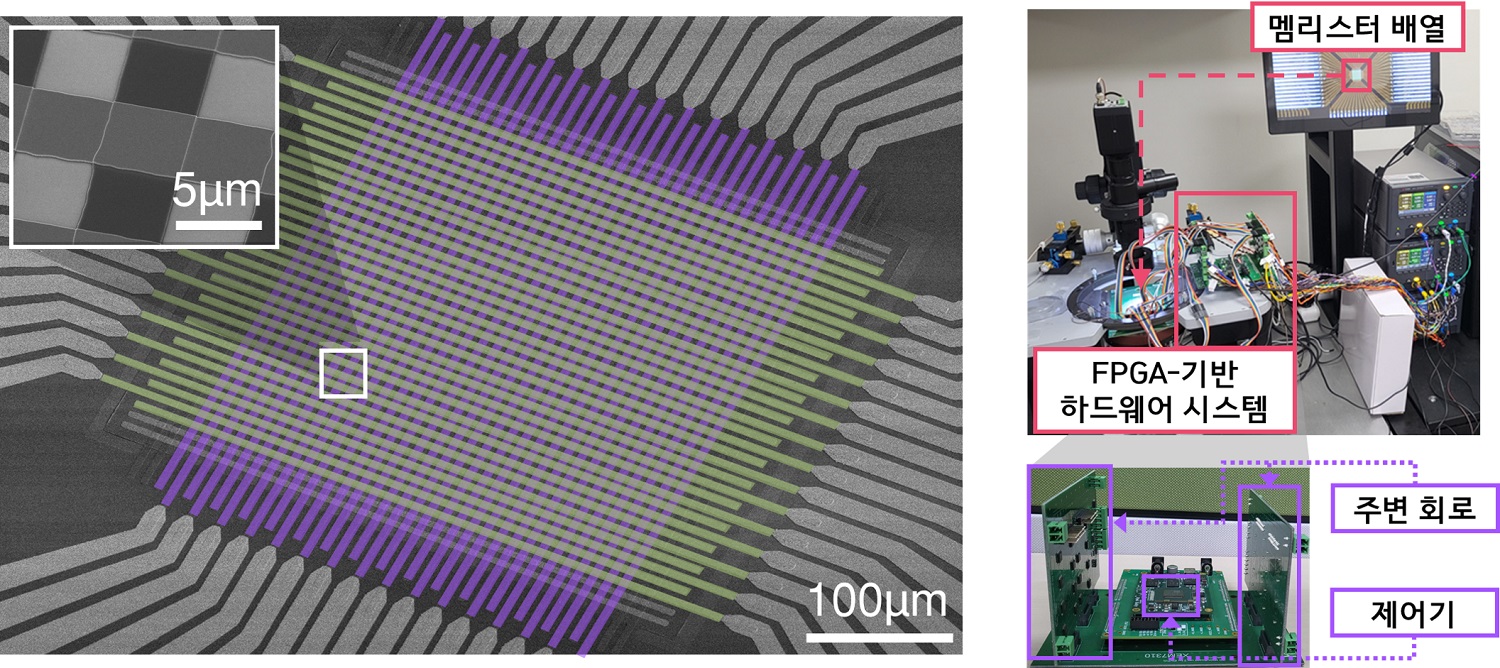

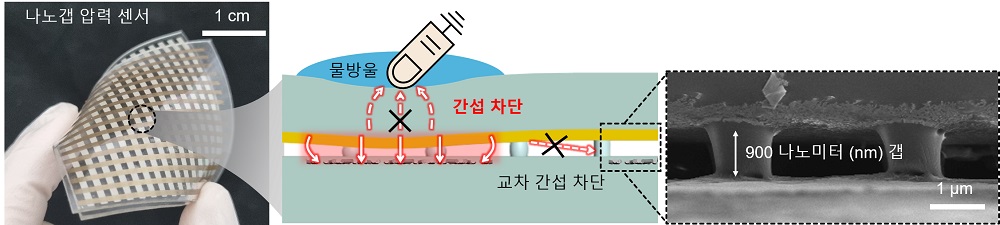

이를 근본적으로 해결하기 위해서는 문제의 원인인 프린지 필드를 억제해야 한다는 결론에 이르렀다. 따라서, 연구팀은 이론적 접근을 통해 프린지 필드에 영향을 미치는 구조적 변수들에 대해 집중적으로 탐구했고 전극 간격을 수백 나노미터(nm) 수준으로 좁힐 경우 센서에서 발생하는 프린지 필드를 수 퍼센트 이하로 억제할 수 있음을 확인했다고 밝혔다.

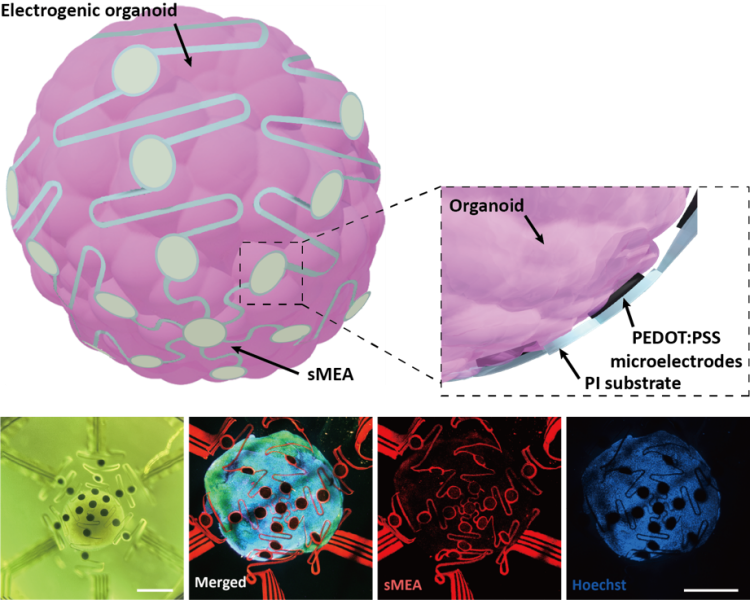

연구팀은 독자적인 마이크로/나노 구조 공정 기술을 활용해 앞서 설계한 900나노미터(nm) 수준의 전극 간격을 갖는 나노 갭 압력 센서를 개발했다. 개발된 센서는 압력을 가하는 물질에 관계없이 압력만을 신뢰적으로 감지했으며 굽힘이나 전자기 간섭에도 감지 성능에 영향이 없는 것을 검증했다.

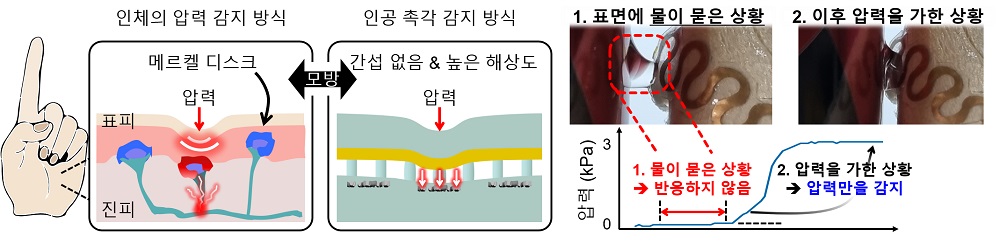

또한, 연구팀은 개발한 센서의 특성을 활용해 인공 촉각 시스템을 구현했다. 인간의 피부에는 메르켈 원반(Merkel’s disc)라는 압력 수용기가 있어 압력을 감지하는데, 이를 모사하기 위해서는 외부 간섭에는 반응하지 않고 오직 압력에만 반응하는 압력 센서 기술이 필요했지만 기존 기술들로는 이러한 조건을 만족시키기가 어려웠다.

윤준보 교수 연구팀이 개발한 센서는 이러한 제약을 모두 극복했으며, 밀도 또한 메르켈 원반 수준에 도달해 무선으로 정밀한 압력 감지가 가능한 인공 촉각 시스템을 구현하는 데 성공했다.

더 나아가, 다양한 전자기기로의 응용 가능성을 확인하기 위해 포스 터치 패드 시스템 역시 개발해 압력의 크기와 분포를 간섭 없이 높은 해상도로 얻을 수 있음을 검증했다고 밝혔다.

윤준보 교수는 “이번 나노 갭 압력 센서는 비 오는 날이나 땀이 나는 상황에서도 기존 압력 센서처럼 오작동하지 않고 안정적으로 동작한다. 많은 사람들이 일상에서 겪어온 불편을 해소할 수 있을 것으로 기대한다.”라고 말했다. 이어 “앞으로 로봇의 정밀한 촉각 센서, 의료용 웨어러블 기기, 증강현실(AR) 및 가상현실(VR) 인터페이스 등 다양한 응용 분야에서 혁신적인 변화를 가져올 수 있을 것이다”고 덧붙였다.

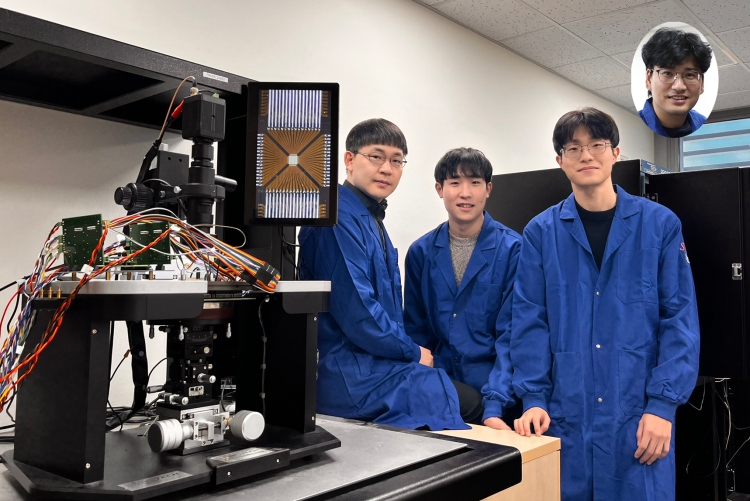

우리 학부 전기및전자공학부 양재순 박사, 정명근 박사과정 그리고 성균관대 반도체융합공학과 유재영 조교수(KAIST 박사 졸업)가 제1 저자로 수행한 이번 연구는 저명 국제 학술지 ‘네이처 커뮤니케이션즈 (Nature Communications)’에 2025년 2월 27일 출판됐다. (논문 제목: Interference-Free Nanogap Pressure Sensor Array with High Spatial Resolution for Wireless Human-Machine Interfaces Applications, https://doi.org/10.1038/s41467-025-57232-8)

한편, 이번 연구는 한국연구재단의 중견연구지원사업과 선도연구센터지원사업의 지원을 받아 수행됐다.